Molto amore per le linee guida per ChatGPT

– Possiamo vedere che un testo proveniente da un chatbot può essere ampiamente riconosciuto, afferma Cormac McGrath.

Crede che l’introduzione dei chatbot influenzerà il modo in cui gli insegnanti si avvicinano ai testi.

– Abbiamo motivo di credere che gli insegnanti scettici sull’influenza dei chatbot leggeranno i testi scritti dagli studenti in modo più critico.

Dopo la pubblicazione della guida, il contenuto è stato comunicato al personale e agli studenti, inclusa una giornata a tema. L’università ha anche condotto diversi workshop e dedicato un progetto al proprio Webcast Panorama ChatGPT.

Uno dei consigli forniti nelle linee guida è evitare esami domiciliari senza supervisione. Se ciò non funziona, è possibile aggiungere un esame da portare a casa, ad esempio interviste orali o appunti delle lezioni.

Attualmente è in corso un fermo lavoro nelle istituzioni per adeguare la didattica e gli esami ai nuovi strumenti.

Non vengono introdotti nuovi moduli d’esame, ad esempio, su come formattare un esame a casa.

– Soprattutto, penso che il dibattito su questo abbia preso slancio, ma ci vuole tempo perché i curricula cambino. Ad esempio, non vengono introdotti nuovi moduli d’esame, afferma Klaus Hottestrand su come progettare un esame a casa.

Come i suoi colleghi a Stoccolma, l’Università di Lund ha nominato una task force. I compiti includono la revisione dei moduli d’esame e il supporto agli insegnanti. Il gruppo ha prodotto raccomandazioni generali e supporto sotto forma di articoli e film sotto il titolo collettivo di Sostegno all’insegnamento digitale. C’è anche una raccolta di domande e risposte sugli strumenti di intelligenza artificiale.

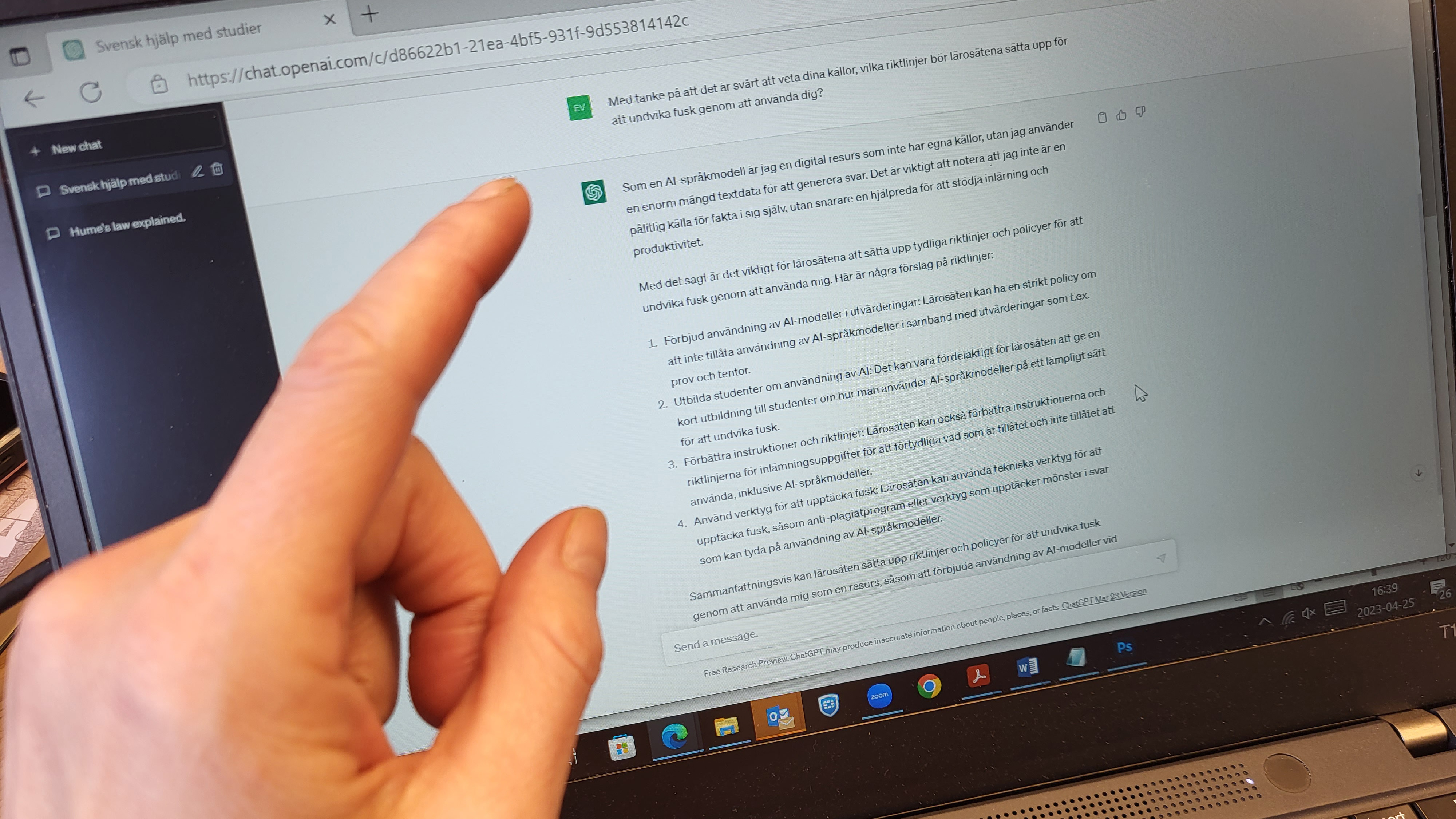

ChatGPT stesso raccomanda linee guida

Quando Curie chiede alla stessa ChatGPT quali linee guida dovrebbero mettere in atto le istituzioni per evitare di imbrogliare usandolo, risponde diplomaticamente: “Va notato che non sono una fonte affidabile di verità, ma piuttosto un assistente che supporta l’apprendimento e la produttività. . Istruzione superiore per evitare di imbrogliare usando me È importante che le organizzazioni sviluppino linee guida e politiche chiare.

Nel riquadro sottostante, GPT presenta le sue proposte di linee guida.

Rachel Forsyth, project manager presso l’Università di Lund, vede sia le sfide che le opportunità con i nuovi strumenti di intelligenza artificiale. È un’opportunità per aumentare il livello di difficoltà dei compiti degli studenti e aumentare il livello di istruzione.

Problemi etici nei chatbot

Rachel Forsyth vede anche importanti problemi etici con gli strumenti.

– Ci sono grandi sfide nei dati utilizzati dagli strumenti. Non sappiamo come vengono utilizzati i dati, cosa contengono o se i dati inseriti sono protetti.

Alla fine di marzo, ChatGPT è stato chiuso in Italia in risposta alle preoccupazioni sulla privacy dell’Autorità italiana per la protezione dei dati personali, un problema che da allora è stato risolto. Ci sono anche problemi con gli utenti dopo che la società che lo ha sviluppato, Open AI, ha scoperto un bug che faceva trapelare informazioni sulle conversazioni degli utenti e sui dettagli dell’account.

Non sappiamo come vengono utilizzati i dati, cosa contengono o se i dati inseriti sono protetti.

Un’altra domanda è chi decide il contenuto dei dati che gli strumenti utilizzano per apprendere.

– Gli stati possono influenzare queste informazioni? Rachel Forsyth afferma che dobbiamo avere un dibattito aperto su come affrontare questo processo.

Gli strumenti di intelligenza artificiale possono elevare il livello di istruzione

Friedrich Heintz, professore presso il Dipartimento di Informatica dell’Università di Linköping, è sulla stessa linea di Rachel Forsyth: gli strumenti di intelligenza artificiale possono essere utilizzati per aumentare il livello di istruzione.

“Pluripremiato esperto del web. Incurabile fanatico della cultura pop. Evangelista estremo del cibo. Specialista televisivo. Pioniere della birra.”