Google ha menzionato l’intelligenza artificiale più di 120 volte

Tecnica

Intelligenza artificiale con agenti, che possono svolgere attività per l'utente. Questo è ciò verso cui si stanno affrettando i maggiori colossi dell’intelligenza artificiale in questo momento. E ora Google ci ha dato alcuni scorci reali su quel futuro.

Durante la conferenza degli sviluppatori I/O di due ore tenutasi martedì sera, Google ha utilizzato l'acronimo ai più di 120 volte. È stato facile rimanere colpiti da tutti i modelli Gemini e dalla loro integrazione sempre più profonda nei prodotti più popolari di Google.

Ma due cose si sono distinte: Gemini Live e Project Astra.

Gemini Live è un chatbot in grado di ascoltare, vedere e parlare. Mostra al mondo la fotocamera di un telefono cellulare e Gemini Live non solo può vedere ciò che vede l'utente, ma anche spiegarlo e analizzarlo.

In un video che Google insiste non sia falso (contrariamente alla moda dell'anno scorso), un utente camminava con il telefono davanti a sé in un ambiente di ufficio. Gemini Live è stato incaricato di rispondere quando ha visto qualcosa in grado di produrre suono. È apparso un oratore e il chatbot lo ha riconosciuto rapidamente. Poi ha dovuto guardare il codice sullo schermo del computer e analizzare il contenuto delle righe. Poi, con la telecamera puntata verso la finestra, Gemini Live ci ha detto che l'ufficio doveva essere a King's Cross a Londra (sede di Google Deepmind, che sviluppa Gemini).

Forse la cosa più sorprendente è che un chatbot può riprodurre retrospettivamente informazioni su cose che la fotocamera di un cellulare catturerebbe solo il più rapidamente possibile. L'utente ha chiesto se Gemini Live potesse vedere dove sono finiti gli occhiali. “Sì, sono sulla scrivania vicino alla mela rossa.”

Un nuovo modello per gli occhiali intelligenti

Gemini Live è un assaggio di ciò che Google intende realizzare con quello che l'azienda chiama Project Astra: un assistente AI globale che diventerà il nostro compagno costante. In un'altra parte della demo, l'utente indossava occhiali intelligenti (quelli che ricordano il prototipo sfoggiato da Google qualche anno fa). Ma come afferma The Verge, è nuovo). L’idea qui è che il chatbot e l’utente dovrebbero vedere il mondo dallo stesso punto di vista.

Ma il progetto Astra è molto più ambizioso di così. A lungo termine, Google prevede che i nostri assistenti AI svolgano il lavoro per noi. Sì, proprio come Open AI e Anthropic, anche il colosso della ricerca si occupa di creare AI utilizzando agenti.

– Penso che siano sistemi intelligenti che dimostrano la capacità di pensare, pianificare e ricordare. “Possono ‘pensare’ molti passi avanti, agire molti passi avanti e lavorare con diversi software e sistemi per fare cose per te, sotto la tua direzione”, ha affermato il CEO Sundar Pichai da una piattaforma offshore a Mountain View, California.

Carico di novità

Se Google avesse offerto solo Gemini Live e Project Astra, l'azienda avrebbe potuto farla franca. Ma lo spettacolo I/O di quest'anno ha fornito un torrente di notizie. Per prelevare solo un campione:

-

Google chiederà ai suoi rappresentanti di “Google per te”. E in risposta a startup intelligenti come Perplexity (e alle voci secondo cui Open AI creerà un motore di ricerca basato sull’intelligenza artificiale), l’esperienza di ricerca con Google sarà presto molto diversa. La panoramica sull’intelligenza artificiale dovrebbe fornire risposte alla ricerca e aiutare con i collegamenti. Con la nuova funzionalità di Google Lens, dovresti essere in grado di effettuare ricerche utilizzando i video. Dovrebbe esserci uno strumento di mappatura e classificazione basato sull’intelligenza artificiale per i risultati di ricerca.

-

Naturalmente, Google Foto può già cercare foto dall’archivio adesso, ma in futuro, quando lo strumento Foto diventerà basato su Gemini, le ricerche potrebbero essere più dettagliate e Google Foto comprenderà meglio il contesto.

-

Il suo collega di Amnesty International. Immagina che tu e i tuoi colleghi abbiate un nuovo compagno di gruppo Slack: un assistente AI che supporta i progetti, tiene traccia di chi ha detto cosa e quando, qual è lo stato delle varie attività e così via. Questa è l'idea con AI Teammate.

-

Veo è il nome del nuovissimo generatore video di Google, che sostituisce il popolare Lumiere. Imagen 3 è l'ultima versione del generatore di immagini dell'azienda.

-

Workspace, il nome collettivo delle app di produttività di Google, sarà infuso con Gemini. L'utente dovrebbe poter collegare i propri dati da Gmail, Calendar e Drive, ad esempio, e poter chiedere aiuto a Gemini per tenere tutto in ordine. Andando avanti, Google spera che gran parte del lavoro attualmente svolto manualmente possa essere automatizzato grazie a Gemini.

-

La novità quasi dimenticata di tutto ciò che è mostrato all'I/O merita probabilmente un destino migliore. Quando Gemini libera i contenuti nell'app per prendere appunti Notebook LM, può creare audio dal materiale. Dobbiamo ascoltare una sorta di podcast tra due chatbot che discutono il contenuto della nota. Un podcast a cui l'utente può unirsi e partecipare in qualsiasi momento.

-

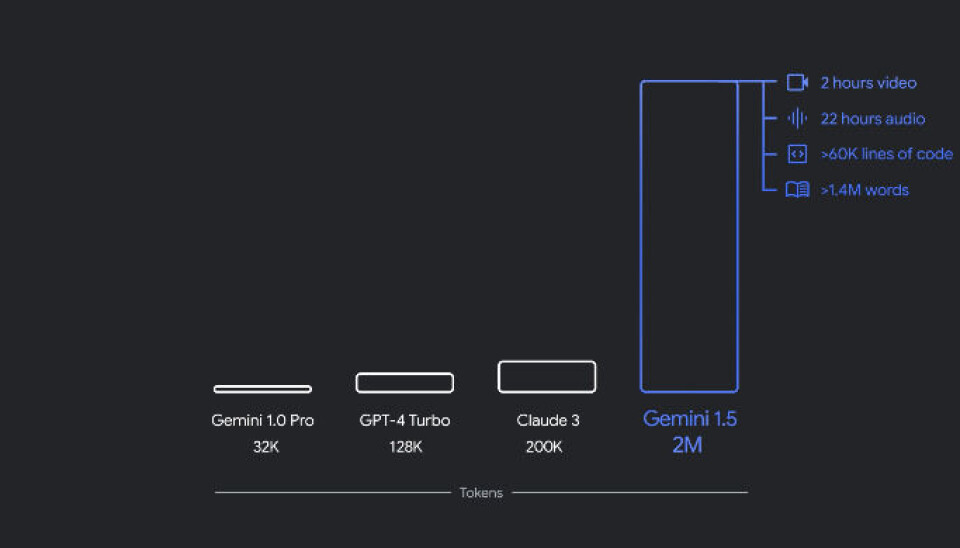

E poi, ovviamente, c’erano gli stessi modelli di intelligenza artificiale. Ora è possibile inviare due milioni di token a Gemini 1.5 Pro. Ciò equivale a circa 2 ore di video, 22 ore di audio, oltre 60.000 righe di codice o 1,4 milioni di parole. Si dice che un altro modello, Gemini Flash, abbia funzionalità di base come il Pro, ma ottimizzato per tempi di risposta più rapidi.

“Evangelista della musica. Fanatico del cibo malvagio. Ninja del web. Fan professionista dei social media. Maniaco dei viaggi sottilmente affascinante.”